Gebruik AI, maar wel met mate.

Door Tijmen Visser / nov 2023 / 3 min

Artificial Intelligence (AI) is dé oplossing! Waarvoor? Hoor ik je denken. Alles! Er is geen probleem dat we niet kunnen tackelen met behulp van AI. Het kent alleen maar voordelen. Of wellicht toch niet? In deze blog gaan we het hebben over de security & privacy risico’s die komen kijken bij het gebruik van AI.

De impact van Artificial Intelligence

Ik zal erkennen dat AI inderdaad veel voordelen met zich meebrengt. Zo ondersteunt het bij het schrijven van blogs (zoals deze), genereert het kunst, inspireert het, levert het input op complexe vraagstukken en nog veel meer. Het gemak en de bereikbaarheid van deze ‘nieuwe’ technologie dragen ongetwijfeld bij aan de hype die eromheen is ontstaan. Zelfs de moderne koelkast wordt verbeterd met AI.

Vanuit mijn rol als Chief Information Security Officer (CISO) mis ik - in de ogenschijnlijk oneindige stroom van positiviteit en potentie - een belangrijk nuance. Het gezegde luidt: “elk voordeel heeft zijn nadeel” en AI is geen uitzondering. Onder al deze hype liggen een aantal serieuze Security & Privacy risico’s die niet onderschat dienen te worden. Laten we het daar eens over hebben.

Voordat we verder gaan, laat mij een ding duidelijk stellen: ik ben niet tegen AI. In tegendeel; ik gebruik het zelf ook. Dat betekent echter niet dat het maar te pas en te onpas in elke applicatie gepropt moet worden. Er zijn ook momenten dat ik er bewust voor kies geen AI te gebruiken, hoewel je tegenwoordig al niet meer zeker kunt stellen dat het niet (stiekem) op de achtergrond meedraait. Waarom kies ik er soms voor om AI uit de weg te gaan?

- Groter aanvalsoppervlak

- Data Privacy

- Gebrek aan transparantie

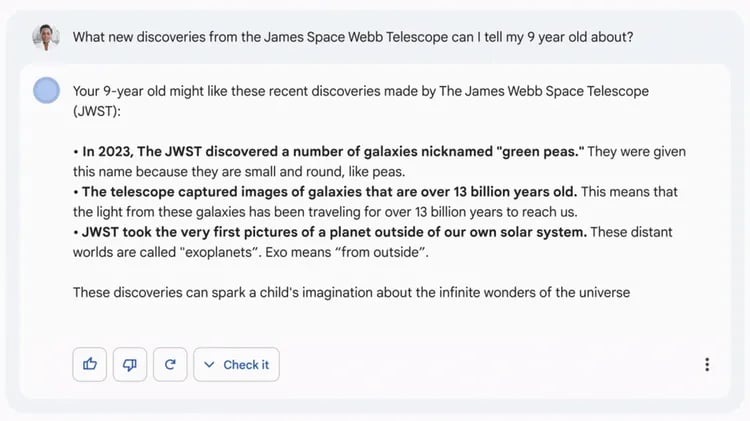

Sommige AI-modellen, met name modellen gebaseerd op deep learning, kunnen worden beschouwd als black boxes, waardoor het moeilijk is om te begrijpen hoe ze tot hun beslissingen komen. Dit verhoogt het risico op mogelijke vooroordelen en ethische problemen en maakt deze moeilijker te identificeren. Ook zijn feitelijke fouten lastiger te identificeren voor gebruikers. Zo maakte Google Bard in zijn eerste demo meteen een fout.

Bron: Google

Artificial Intelligence-beleid

Om bovenstaande risico’s (deels) te mitigeren hebben we er binnen Avisi voor gekozen om een AI beleid op te stellen, als onderdeel van ons Information Security Management System (ISMS). Dat klinkt heel gewichtig maar dat hoeft het niet te zijn. Je zal merken: met gezond verstand kom je een heel eind. Wel hebben we hiervoor een aantal principes in acht genomen:

- Evaluatie en selectie van leveranciers

Beoordeel grondig de beveiligingspraktijken, het privacybeleid en de naleving van regelgeving van potentiële AI-leveranciers. Zorg ervoor dat ze over robuuste beveiligingsmaatregelen beschikken, zoals versleuteling, toegangscontroles en regelmatige beveiligingsaudits.

- Gegevensverwerking en privacy

Definieer duidelijke richtlijnen voor gegevensverwerking en -opslag met externe AI-aanbieders. Implementeer technieken voor het anonimiseren en pseudonimiseren van gegevens om de privacy van gebruikers te beschermen. Leg deze richtlijnen en eisen vast in uitgebreide (verwerkers)overeenkomsten waarin expliciet wordt ingegaan op beveiligings- en privacyvereisten.

- Bewustzijn en training van werknemers

Informeer medewerkers over de risico's van AI-integratie en benadruk best practices voor veilige ontwikkeling, gegevensverwerking en naleving van het informatiebeveiligingsbeleid.

De kernprincipes vanuit ons AI beleid zijn op te splitsen in input (de data waarvan je het AI-model voorziet) en output (de respons die je uiteindelijk terugkrijgt). Voor de input hebben we afgesproken geen persoonsgegevens in te voeren en geen vertrouwelijke (bedrijfs)informatie te delen. Bij afwijking hiervan, borgen we schriftelijke toestemming. Voor de output hebben we de medewerker in kwestie verantwoordelijk gesteld. Denk aan het beoordelen en eventueel corrigeren van fouten of onvolledigheden. Op deze laagdrempelige manier kun je een grote stap maken om bovenstaande risico’s voor een groot deel te mitigeren.

Conclusie

De integratie van AI in het bedrijfsleven en de maatschappij brengt zowel veel mogelijkheden als potentiële beveiligings- en privacyuitdagingen met zich mee. Door een concreet informatiebeveiligingsbeleid te ontwikkelen, kunnen organisaties deze risico's beperken en profiteren van de voordelen van AI terwijl hun systemen, gegevens en gebruikers worden beschermd. Resumerend: gebruik AI, maar wel met mate.

| Security & Privacy Officer

Door Tijmen Visser. / nov 2023